-

行业资讯

INDUSTRY INFORMATION

【导读】 人才测评产品处理的往往不是“普通简历信息”,而是心理特征、行为偏好、视频音频乃至生物识别等高敏数据。《个人信息保护法》将这类处理活动推到更严格的合规框架之下:同意要“单独”,采集要“最小必要”,自动化决策要“透明且可复核”。本文从实务视角回答人才测评产品如何做到数据合规:先用条款与典型业务环节对齐合规红线,再拆解5项隐私保护技术的适用边界与组合路径,最后给出一套可审计的治理闭环,适合HR负责人、产品经理、技术与合规团队协同落地。

人才测评被广泛用于招聘初筛、胜任力评估、干部盘点、培训测评等场景。现实矛盾在于:业务希望更“准”,算法希望更“全”,但法律强调更“少”、更“清楚”、更“可控”。从监管逻辑看,PIPL并不否定测评本身,而是要求把个人信息处理活动变成一套可解释、可追溯、可退出的流程。对人才测评产品而言,合规的难点不在写一份隐私政策,而在于把“告知—同意—处理—存储—共享—删除”的每一步,都落实到交互、日志、权限与技术控制上。

一、合规基准:人才测评数据的红线与雷区(人才测评产品如何做到数据合规?先从这里对标)

人才测评的合规门槛之所以更高,核心原因是两点:其一,数据类型更容易落入“敏感个人信息”范围;其二,测评结果常被直接用于招聘、晋升等重要决策,天然带有自动化决策与公平性风险。对标PIPL时,建议先把合规基准压缩成三条“硬约束”:单独同意、最小必要、透明可复核。

1. 敏感个人信息的“单独同意”义务

在测评产品中,最容易踩雷的是“默认把敏感信息当普通信息处理”。PIPL对敏感个人信息有明确界定(如生物识别、医疗健康、行踪轨迹等),并要求处理敏感个人信息应取得个人的单独同意,且需告知必要性与对个人权益的影响。落到测评场景,常见触发点包括:

- 视频面试/远程测评:人脸图像、声音、面部特征点、微表情分析标签等,一旦用于身份核验或分析,都可能被认定为生物识别相关信息。

- 心理测评与人格测评:表面是题目选择,但输出往往形成“心理特征画像”,在求职者视角,这类结果对其权益影响更直接(录用、淘汰、岗位匹配)。

- 防作弊与风控:键鼠轨迹、设备指纹、地理位置、摄像头常开等数据,若没有必要性证明与单独同意支撑,很容易被质疑“过度收集”。

合规上,“单独同意”不是在用户协议里多加一行字,而是要做到三点可核验:单独展示、单独选择、单独留痕。交互上建议将“是否采集视频/人脸/音频”“是否用于反作弊”“是否用于模型训练迭代”等拆成独立开关,并在后台保存同意时间戳、版本号、目的说明与撤回路径,才能支撑后续审计与争议处理。

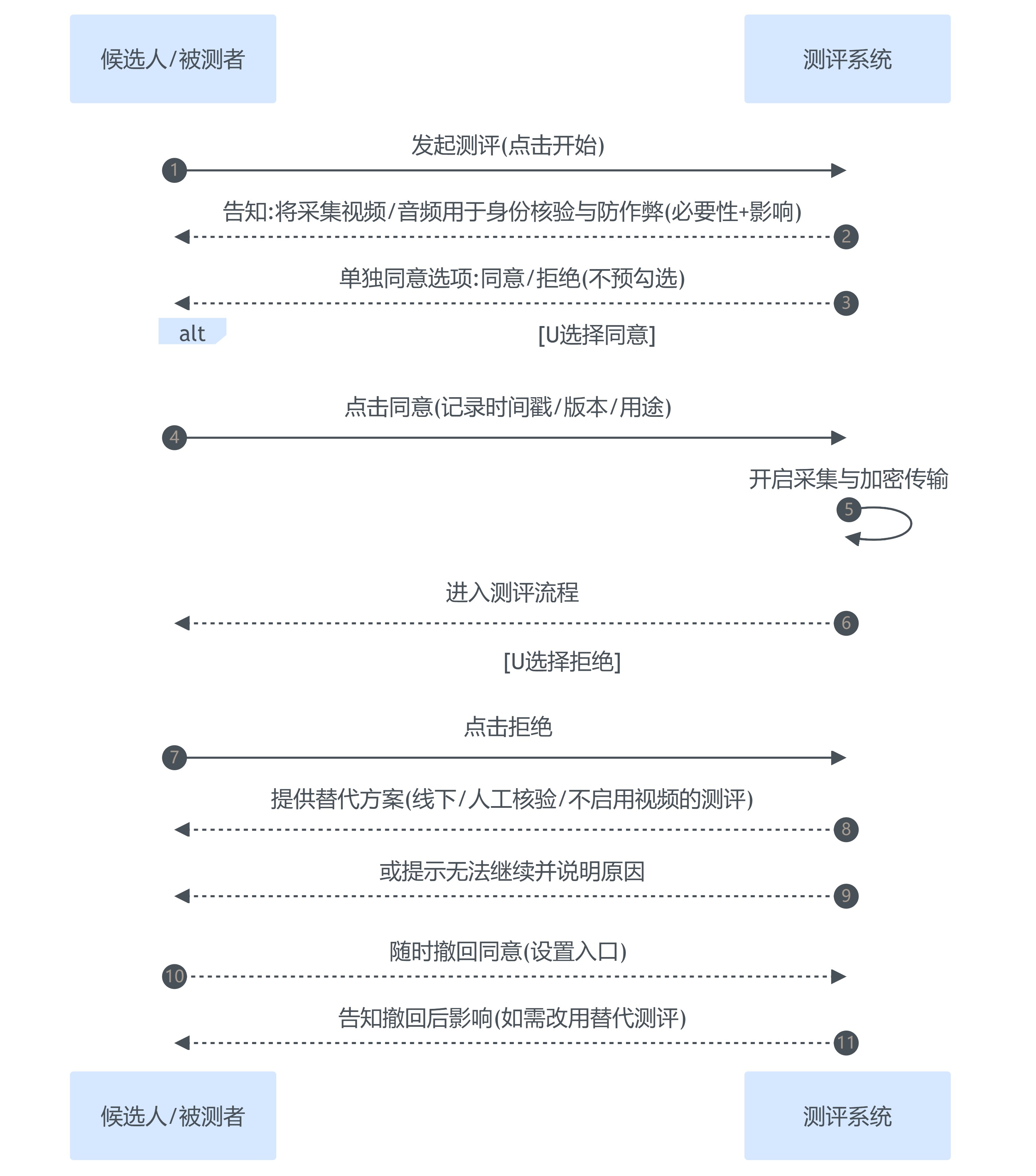

图表1给出一个更贴近实务的“单独同意”交互时序(可直接交给产品与研发做联调依据)。

提醒:如果业务没有替代方案,至少要把“拒绝的后果”讲清楚,否则会被认为变相强制同意。

2. 自动化决策的透明度与公平性

不少企业把测评当作“高效率筛选器”:分数低于阈值即自动淘汰;AI面试给出“沟通能力偏低”即终止流程。这类场景会触发PIPL对自动化决策的要求:应保证透明度与结果公平公正,并提供不合理差别待遇的救济路径。对测评产品而言,实务落点主要在两件事:

第一,透明度要落在“可解释的告知颗粒度”。

不是要求公开模型参数,而是要让被测者知道:哪些数据被使用、用于什么目的、会产生怎样的影响、是否用于自动化筛选。举例来说,若系统会把“面试视频”用于打分并影响是否进入下一轮,那么告知应明确到“用于生成沟通表现相关评分,并可能用于初筛”。

第二,建立“人工复核”的可操作机制。

很多产品写了“如有疑问可联系客服”,但没有形成制度与闭环:谁复核、复核什么、多久给答复、能否更正。更稳妥的做法是把复核做成流程:对外提供入口,对内设定SLA(如3个工作日内回应),并能产出复核记录(用于后续合规审计与争议处置)。

从反例看,如果测评只用于“发展建议”而不用于录用淘汰,透明度与复核要求的紧迫性会降低,但并不等于可以忽略告知与最小必要。边界在于:是否对个人权益产生实质影响,尤其是就业机会与差别对待风险。

提醒:当测评结论被用于薪酬、晋升、录用等关键决策时,建议把“复核权”写进企业制度而非仅停留在产品文案。

3. 数据全生命周期的“最小必要”

“最小必要”常被误解为“少填几个字段”。在人才测评里,它更像一条贯穿全链路的控制原则:采集最小、使用最小、留存最小、共享最小。我们建议用“目的—数据—环节”三列做数据映射:每一类数据都要能回答三个问题——为什么要采集、在哪个环节使用、何时删除/匿名化。

- 采集端:能用岗位信息与作答结果完成测评的,就不要强制采集身份证号、通讯录、精确定位;反作弊若能用限时与随机题库解决,就不应默认开启摄像头常开。

- 使用端:模型训练与在线评分要分开治理;“用于训练迭代”的数据应单独同意,并可选择退出。

- 存储端:原始作答、视频音频、日志要分类分级;将“可直接识别个人”的字段与“测评内容”分库存储,并以权限与密钥做隔离。

- 删除/留存端:明确保留期限与触发条件(如招聘结束后X天删除原始视频,仅保留必要的合规审计日志)。

这里有一个常见误区:为了“可追溯”,把所有原始数据长期留存。合规上,可追溯不等于留存原始敏感信息,很多情况下留存脱敏后的审计证据更合理(例如留存哈希、访问日志、同意记录、评分版本号),而不是把视频与原始答卷无限期保存。

提醒:最小必要的难点是“目的变更”——一旦用途从测评扩展到画像营销或跨岗位复用,需要重新评估合法性与同意范围。

二、技术解法:构建数据合规的5大技术基石

仅靠制度与文案,难以抵御真实的数据风险:外部攻击、内部越权、供应链泄露、误配置暴露等都可能发生。更关键的是,人才测评要“可用”,意味着要计算、要建模、要产出报告;因此技术目标不是把数据“锁死”,而是实现数据可用不可见。下面5项隐私保护技术(PETs)是当前测评产品最常见、也最容易与PIPL义务对齐的组合工具。

1. 全链路加密技术——把“传输与存储”变成底线能力

在人才测评链路中,风险最高的往往不是“系统算错”,而是数据在传输、存储、备份、日志中以明文形式暴露。全链路加密建议分成三层:

- 传输加密:测评作答、音视频上传、报告下载等全程使用TLS(至少1.2及以上),并禁用不安全套件;移动端还要关注抓包风险与证书校验。

- 存储加密:对身份证号、手机号、邮箱、音视频文件、测评分数等关键字段做加密存储;数据库备份、对象存储与搜索索引同样需要覆盖。

- 密钥管理:把“有没有加密”升级为“密钥是否可控”。密钥与数据分离、分权管理(运维不等于能解密)、定期轮换、泄露应急(吊销与重加密)是合规审计最看重的部分之一。

典型落地场景:HR需要查看报告,但并不需要接触原始答卷与音视频。产品可以将“报告渲染服务”与“原始数据存储”分域隔离,通过最小权限与临时授权(短期Token)减少横向移动风险。

边界条件:加密并不能解决“过度收集”或“未经同意使用”的合法性问题;如果目的不成立、同意不充分,加密只能降低泄露损失,无法让处理行为本身变得合法。

提醒:很多事故来自日志与调试数据,建议把“日志脱敏与加密”纳入同一套安全基线。

2. 去标识化与匿名化处理——把“可识别性”降到业务所需的最低

去标识化与匿名化经常被混用,但在合规与技术上差异很大:

- 去标识化:通过替换、哈希、分离存储等手段,让数据在不借助额外信息的情况下难以直接识别到个人,但在一定条件下仍可复原(例如通过映射表)。测评产品做模型训练、AB测试、题库优化时,通常用去标识化更现实。

- 匿名化:处理后无法识别且不可复原,理论上风险最低,但对测评业务而言并不容易——因为业务往往要“回看某个候选人的结果”“提供复核”“支持删除请求”。一旦保留可回溯能力,就很难满足严格匿名化的不可复原性。

实务建议是把“可识别性”做成分层治理,而不是追求一步到位:

- 在线测评与出报告:采用去标识化,保证系统内部可关联、外部不可直接识别;

- 内部运营分析与模型评估:使用更强的去标识化(分桶、泛化、减少维度),并限制访问人群;

- 对外发布行业报告/基准报告:尽量走匿名化或近似匿名化(如k-匿名、l-多样性、t-接近性),并配合差分隐私(下一节)降低反推风险。

一个常见反例:把姓名手机号删掉,就认为完成匿名化。但如果还保留岗位、学校、毕业年份、城市、面试时间等组合字段,在小样本场景下依然可能被重新识别。人才测评的数据维度多、组合空间大,重识别风险更高,评估时要特别关注“稀有组合”。

提醒:匿名化不是“删字段”,而是要证明在合理手段下不可复原;否则更稳妥的表述与治理仍应按去标识化处理。

3. 差分隐私——在统计与洞察场景中兼顾可用性与保护强度

很多企业希望用测评数据做“人才画像与组织洞察”:不同岗位的能力分布、某区域候选人的测评趋势、培训前后的能力变化等。这类输出通常是统计结果而非个人报告,但如果统计口径过细(例如某个小团队、某个稀缺岗位),仍可能泄露个体信息。差分隐私提供了一条更可控的路径:在统计查询结果中注入经过校准的噪声,使攻击者无法从输出中判断某个人是否在数据集中。

落地时建议先明确三件事:

- 差分隐私的对象是“统计输出”,不是原始数据。它适合报表、BI接口、对外研究报告等。

- 噪声强度要与业务精度交易。噪声越大隐私越强,但结果越不稳定。

- 需要配套访问控制与查询预算(隐私预算ε):如果允许无限次查询,即使每次都加噪,也可能通过多次平均抵消噪声,最终反推个体信息。

典型测评场景:集团想做“不同事业部应届生沟通能力分布”对标,差分隐私可以在“分布图/均值/分位数”等输出层保护个体,减少因样本量较小导致的泄露风险。

边界条件:差分隐私不适合用于单个候选人的评估分数(那不是统计输出),也不适合在数据本身质量不佳、样本量极小的场景强行使用,否则会让业务误读。

提醒:差分隐私不是“加点随机数就行”,需要把查询接口、预算管理与审计纳入同一套设计。

4. 联邦学习——让“数据不出域”的联合建模成为可能

人才测评模型通常需要大量样本,但企业之间、集团子公司之间往往又无法直接共享原始数据:既有商业竞争,也有合规风险。联邦学习提供的思路是“数据不动模型动”:各方在本地用自己的数据训练模型,仅上传参数/梯度到中心做聚合,从而形成更好的全局模型。

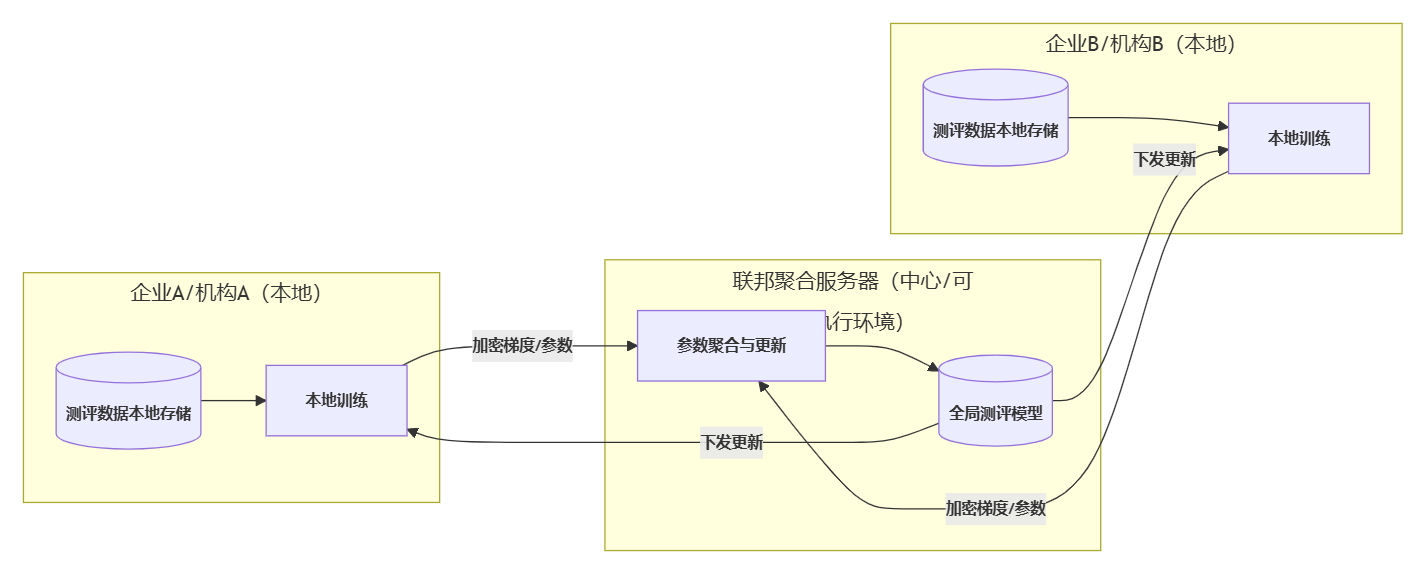

图表2给出联邦学习在人才测评中的典型架构示意(强调“本地数据不外传”的治理价值)。

在测评业务中,联邦学习更适合两类需求:

- 集团内部多子公司联合建模:各单位本地保留员工/候选人数据,只共享模型更新;

- 测评厂商与客户共建模型:客户不希望原始答卷与视频外流,但希望模型能适配自身岗位与文化。

但联邦学习不意味着“天然合规”。它至少还需要三类配套措施:

- 参数泄露防护:梯度也可能泄露个体信息,需配合安全聚合、差分隐私或加密计算;

- 参与方治理:谁能加入联邦、如何退出、如何审计、如何处理争议;

- 目的限定与同意:如果联邦训练会用到个人信息(即便不出域),也要明确告知是否用于训练迭代、是否共享模型收益,并纳入同意范围或合法性基础。

提醒:联邦学习是“降低共享风险”的架构,不是“绕开同意”的捷径。

5. 安全多方计算(MPC)与同态加密——在“密态”下完成关键计算

当业务希望在不暴露原始数据的情况下完成更复杂的计算(比较、排序、联合统计、风控校验),MPC与同态加密往往更直接。

- MPC:多方共同计算一个函数,每方只提供自己的输入,但任何一方都无法看到其他方输入;适合跨部门、跨机构的联合测评指标计算。

- 同态加密:允许在密文上直接计算,解密后得到与明文计算一致的结果;适合“在云端计算但不让云端看到数据”的场景。

人才测评中的一个高价值场景是“密态评分与排名”:HR希望看到候选人综合得分排序,以便安排面试,但不希望(或不被允许)接触候选人的原始答卷、视频片段或敏感标签。通过同态加密或MPC,可以把“可见内容”限制在业务必要范围内,把“不可见内容”留在受控域中,从技术上落实最小必要。

边界条件也很明确:MPC/同态加密通常带来性能与工程复杂度成本,题目数多、并发高的视频测评场景,若全量采用重加密计算可能导致体验下降。实践中更常见的策略是:对“高敏字段与关键计算”用密态计算,对一般字段仍用常规加密与权限控制,形成分层方案。

提醒:选择MPC/同态加密前,先把“哪些计算必须密态完成”界定清楚,否则容易技术投入大但收益不明显。

表格1:5项隐私保护技术对比表(适用场景、合规价值与局限性)

| 技术 | 核心原理 | 适用测评场景 | 合规价值(对应义务) | 局限性/注意点 |

|---|---|---|---|---|

| 全链路加密 | 传输/存储加密 + 密钥分权 | 作答上传、音视频、报告下载、备份 | 降低泄露与篡改风险(安全保障义务) | 不解决过度收集与未经同意使用 |

| 去标识化/匿名化 | 降低可识别性/不可复原 | 训练、运营分析、对外报告 | 支撑最小必要与风险降低 | 小样本可重识别;匿名化很难完全满足 |

| 差分隐私 | 统计输出加噪 + 预算控制 | 能力分布报表、趋势洞察 | 降低统计发布反推风险 | 噪声影响精度;需治理查询接口 |

| 联邦学习 | 数据不出域,仅共享参数 | 多机构/多子公司联合建模 | 降低共享与跨域风险 | 梯度可能泄露;仍需同意与治理 |

| MPC/同态加密 | 密态联合计算/密文计算 | 密态评分、排序、联合指标 | 让关键计算不暴露输入(最小必要) | 性能与工程成本高,需分层落地 |

三、管理闭环:从技术落地到组织治理的合规体系

技术能把风险降下来,但很难单独回答三个管理问题:谁负责、如何证明、出了事怎么处理。人才测评产品要真正做到可持续合规,需要把“事前评估—事中控制—事后审计”做成闭环,并在组织层面明确责任边界。可以把它理解为:技术是刹车系统,治理体系是交通规则与执法机制,两者缺一不可(本模块仅用这一处类比)。

1. 个人信息保护影响评估(PIA)常态化

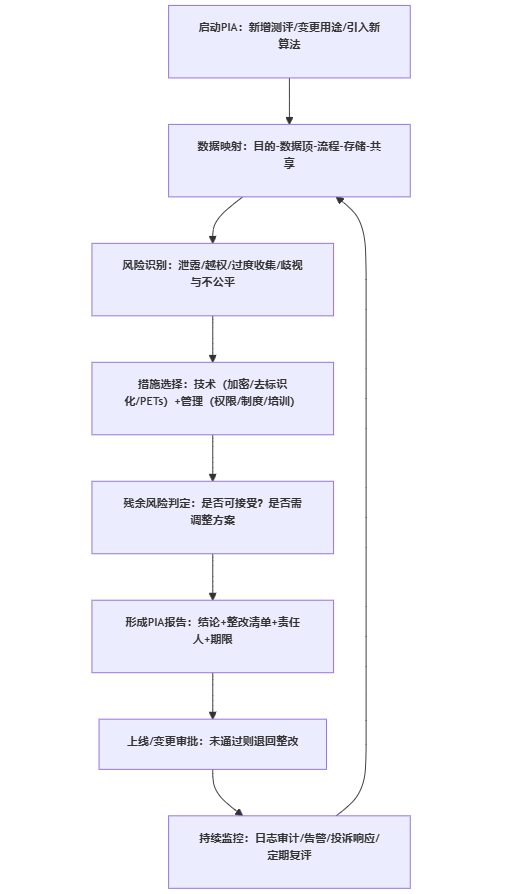

PIPL要求在处理敏感个人信息、开展自动化决策、委托处理、向第三方提供或公开个人信息等情形下,开展个人信息保护影响评估并留存记录。对人才测评产品而言,PIA不应是合规部门的“文件作业”,而应是产品上线前的准入机制。

PIA建议至少覆盖以下可检查要点:

- 目的必要性:为什么要采集视频?不用视频能否满足防作弊?是否存在更少侵入的替代方案?

- 数据范围与周期:哪些字段必须采集?原始视频保存多久?招聘结束是否自动触发删除?

- 权益影响评估:测评结果是否用于淘汰?是否存在年龄/性别/地区的差别影响?

- 技术与管理措施:加密、去标识化、权限、审计、供应商约束是否到位?

- 残余风险与决策:风险是否可接受?需要哪些整改后才能上线?

图表3给出PIA执行流程(建议把每一步的产出物写进研发与上线门禁,例如没有“数据映射表”就不得进入灰度)。

提醒:如果测评产品引入新的模型特征(例如新增“语音情绪识别”),即使UI未变,也应视为高风险变更重新评估。

2. 数据分类分级与权限管控

分类分级的价值在于把“安全投入”与“风险等级”绑定,避免平均用力。对测评产品,建议至少分三层:

- S级(敏感/高影响):视频音频、人脸特征、心理画像、身份证号、反作弊日志等;

- A级(重要):测评题库、评分规则版本、岗位模型参数、候选人联系信息;

- B级(一般):访问行为日志(脱敏后)、页面埋点(去标识化后)等。

权限管控建议落实到四个可审计点:

- 最小权限:HR能看报告,不一定能看原始作答;管理员能运维,不一定能解密;

- 分权审批:高敏数据导出、跨系统共享、批量下载必须有审批与理由;

- 全量留痕:谁在何时访问了哪个候选人的哪些数据;

- 异常告警:短时间大量查询、非工作时段访问、跨地域登录等触发告警。

一个常见漏洞是“测试账号复用生产权限”,尤其在测评旺季临时扩容时容易发生。合规审计时,这类问题往往比外部攻击更容易被追责,因为它可被视为管理失当。

提醒:权限设计要与岗位职责同步更新,否则离职与调岗将带来长期越权风险。

3. 供应商管理与数据处理协议(DPA)

人才测评产品很少是纯自研:SaaS测评、视频面试平台、题库服务、云存储、短信服务、模型API等都会引入供应链处理关系。PIPL对委托处理有明确要求:需约定目的、期限、方式、种类、保护措施、权利义务,并对受托方处理活动进行监督。

落地上建议把供应商管理做成“准入—合同—验收—持续审计”四步:

- 准入:等保、ISO27001、渗透测试报告、数据中心位置、分包商清单、历史安全事件;

- 合同(DPA):明确数据所有权、禁止二次使用(尤其是“用于训练通用模型”)、删除与返还机制、泄露通知时限、审计权;

- 验收:接口调用最小化、字段白名单、加密与日志脱敏落地证明;

- 持续审计:年度安全复评、重大变更通知、出境路径核查(如涉及跨境访问与支持)。

边界提示:即便供应商承诺“数据不出境”,也要关注其远程运维、海外研发访问、日志回传等隐性链路;这些往往不是口头承诺能覆盖的,需要技术与制度双重证明。

提醒:对测评厂商而言,“把数据用于产品迭代”是常见商业诉求,但必须与客户和被测者的授权范围一致,否则容易形成系统性合规风险。

4. 建立用户权利响应机制(人才测评产品如何做到数据合规的最后一公里)

PIPL赋予个人对其信息的查阅、复制、更正、删除、撤回同意等权利。测评产品如果只在隐私政策里写“请联系邮箱”,但没有内部流程与系统能力,就会在投诉与审计中暴露短板。建议把权利响应机制产品化、流程化:

- 入口清晰:在测评端与报告端提供权利申请入口(查阅、删除、撤回训练授权等);

- 身份核验:以最小必要方式核验申请人身份,避免“为核验而过度采集”;

- 响应SLA:明确受理、处理、反馈时限;

- 系统支持:能够定位数据、执行删除(包括备份策略下的删除规则)、同步第三方受托方删除;

- 留存证据:保留处理记录,用于证明企业已履责。

反例提示:删除请求最难的是“分布式与备份”。如果系统架构没有提前设计“可删除性”(例如对象存储未分桶、数据血缘不清),后期往往只能人工排查,既成本高又容易遗漏。因此,把删除能力当作产品基础设施,而非事后补丁,更符合长期合规与运营效率。

提醒:当测评结果已进入录用决策档案时,要区分“依法需留存的记录”与“可删除的原始材料”,并在告知中说明边界。

表格2:人才测评产品合规自查清单(可直接用于内审/选型)

| 维度 | 检查要点 | 证据/产出物 | 常见整改方向 |

|---|---|---|---|

| 告知与同意 | 敏感信息是否单独同意?是否默认勾选?是否可撤回? | 同意记录(时间戳/版本/用途)、交互截图 | 拆分授权开关;撤回入口;同意链路留痕 |

| 最小必要 | 字段是否与目的匹配?反作弊是否有替代方案评估? | 数据映射表、字段白名单、PIA记录 | 砍掉非必要字段;反作弊分级启用 |

| 自动化决策 | 是否说明用途与影响?是否提供人工复核? | 告知文案、复核SOP、复核工单记录 | 设置复核入口与SLA;输出可解释要素 |

| 安全措施 | 传输/存储是否加密?密钥是否分权?日志是否脱敏? | 安全基线、KMS策略、审计日志 | 补齐加密与密钥管理;日志脱敏;告警 |

| 权限与审计 | 是否最小权限?高敏导出是否审批? | RBAC配置、审批记录、访问日志 | 角色重构;高敏导出审批;异常告警 |

| 供应商治理 | 是否签DPA?是否禁止二次使用?是否可审计? | DPA条款、供应商评估表、复评报告 | 补充审计权与删除条款;限制分包 |

| 留存与删除 | 是否有留存期限?删除能否覆盖备份与第三方? | 留存策略、删除流程、删除证明 | 建设可删除性;统一数据血缘与工单 |

结语

回到开篇问题:人才测评产品如何做到数据合规?我们在实践中看到,真正有效的路径不是“写更长的隐私政策”,而是把PIPL的要求翻译成可执行的产品机制、技术控制与组织流程,并能在审计与争议中拿出证据链。面向企业与测评厂商,给出5条可直接落地的建议:

- 先做数据映射再谈技术选型:用“目的—数据项—环节—存储—共享—删除”梳理全链路,明确哪些是敏感信息、哪些触发自动化决策要求。

- 把单独同意做成可复用组件:敏感信息授权、训练授权、共享授权分别独立;每次授权留存版本与时间戳,并提供撤回入口。

- 用“分层技术栈”替代“一刀切”:基础层全链路加密+权限审计;分析层去标识化/匿名化;统计发布层叠加差分隐私;跨域建模用联邦学习;关键计算用MPC/同态加密。

- 把PIA作为上线门禁:敏感信息、自动化决策、用途变更、供应商变更都触发PIA;PIA结论要能转化为研发任务与验收标准。

- 把权利响应能力产品化:查阅、删除、撤回同意与复核请求要可工单化、可追踪、可证明,避免在投诉时临时“手工处理”。

只要把“合规”当作一套可运行的系统工程,而不是一次性文档项目,人才测评既能满足业务对效率与精准度的需求,也能在PIPL框架下形成更可持续的信任基础。