-

行业资讯

INDUSTRY INFORMATION

【导读】 招聘系统上线后,很多企业发现流程更“顺”了,但面试质量未必更“准”。本文以面试官培训为主线,围绕“招聘系统上线后,面试官培训内容应该包含哪些模块?”拆解一套可直接落地的赋能体系:先统一角色认知,再补齐ATS与AI协同能力,进而用结构化方法把评价变成可复用的数据资产,最后用候选人体验与合规把风险降到可控范围。适用于HRBP、招聘负责人、业务面试官与面试官教练。

招聘系统(ATS/招聘管理平台)上线,往往被当作一个“IT项目收尾点”:账号开通、权限配置、流程跑通、培训一场,然后进入运行期。现实矛盾是:系统确实能把“流程动作”标准化,却不会自动把“判断能力”标准化;AI能把候选人排序,却无法替面试官解释业务真实需求与团队协作方式。于是我们常看到两类后果:一类是面试官把系统当成“评分录入器”,另一类是面试官绕开系统回到线下笔记,导致数据沉淀失败、评价口径不一致,最终影响招聘质量与合规。

从实践看,面试官培训要解决的不是“会不会用”,而是“用系统之后,如何把判断做得更可检验、更一致、更可复盘”。下面按模块给出完整框架。

一、理念重塑与角色认知

面试官培训的第一步不是教功能,而是把面试官的定位从“凭经验拍板”校准到“基于证据的评估者”,否则系统越先进,反而越容易形成形式主义的打分。

1. 数字化转型中的面试官新定位

现象层面,招聘系统上线后,面试官的动作被拆成一系列可追踪节点:查看简历、确认面试、填写评价、给出结论、推动offer审批。很多业务面试官会自然把“新增的节点”理解为行政负担,于是出现两种典型行为:

- 只完成最低限度动作:看简历—面试—随手给个分,评语以“还行/一般/不匹配”收尾。

- 完全绕开系统:线下用Excel/微信/口头沟通,最后让HR代录。

原因在于角色认知没有同步升级:系统把面试官推向一个“评估者+数据生产者”的位置——面试官的每一次评分与评语,都会影响后续的复盘、候选人复用、甚至AI模型的迭代。如果面试官不理解这一点,数据质量必然劣化,AI输出也会被“脏数据”放大偏差。

机制上,数字化招聘把决策链条从“个人直觉”改为“多人协作+证据留痕”:

- 协作:同岗多人面试时,需要口径一致,否则综合结论无法形成稳定信号。

- 留痕:关键判断必须能追溯到事实证据(项目、行为、结果、学习)。

- 可复盘:入职后绩效回看能反推面试问题与评分偏差,进而调整题库与胜任力权重。

对策上,建议把面试官职责明确为三件事:

- 用结构化证据做判断(而非用印象词);

- 用系统把证据沉淀为组织资产(而非个人笔记);

- 与HR/AI共同完成决策(而非单点拍板)。

提醒一句:若岗位极度稀缺、样本量很小(例如顶尖科学家、极少数合伙人级别),完全标准化可能反而压缩识别空间,需要保留“非结构化访谈+结构化记录”的折中做法。

2. 招聘系统的底层逻辑与价值共识

很多培训只讲“按钮在哪里”,却不讲“为什么要这么做”。对面试官而言,价值共识至少包含三层:

第一层是效率:统一邀约、日程、面试记录与审批,让沟通成本下降。这也是最容易被看见的收益,但不是核心。

第二层是一致性:系统通过必填项、评分维度、题库与模板,把不同面试官的“观察角度”拉回到同一框架内。它不是限制个体判断,而是减少“同一个候选人,在不同面试官那里被问成两套题”的偶然性。

第三层是合规与可解释:当候选人对拒绝理由、信息使用提出疑问时,系统记录能帮助企业证明决策基于岗位相关证据而非敏感信息。尤其在个人信息保护要求更严格的背景下,可追溯本身就是一种风险控制能力。

我们建议在培训中把ATS价值用一张“因果链”讲清楚:

- 输入端(岗位画像/JD/评估维度)质量越高 → AI初筛越准确、面试题越聚焦;

- 过程端(记录与评分)越规范 → 数据越可比、复盘越有效;

- 输出端(录用质量/留存/试用期表现)越稳定 → 组织越愿意持续投入。

这里有一个边界条件:如果企业岗位体系与胜任力模型长期缺失,仅靠ATS本身无法补齐“标准”,培训就必须把“标准建设”纳入范围,否则系统会变成流程工具而不是决策工具。

3. 拒绝黑箱操作:建立对算法的信任与边界认知

系统上线后引入AI功能(简历打分、视频面试分析、推荐排序)几乎是常态。争议点也在这里:面试官要么盲信AI,要么全盘否定。两种极端都会带来问题。

更可行的做法是把AI当作“提示系统”,并在培训中明确三条边界:

- AI擅长什么:信息提取、规则匹配、历史数据的相似性判断、在大样本下的排序与分流。

- AI不擅长什么:价值观冲突识别、复杂利益权衡下的判断、团队化学反应、非线性成长潜力。

- AI出错时的信号:对非典型履历惩罚(跨界/创业/空窗)、对简历包装更友好、对“低频但关键能力”不敏感。

对应的标准动作应该是:AI提示—人工复核—结构化反馈。例如:AI把某候选人排在前10%,面试官复核时要回答两个问题:

- 它为什么排在前10%(哪些证据触发权重)?

- 我是否看到相反证据(项目真实性、难度、角色贡献、学习曲线)?

这种做法既能利用AI提效,也能把“人”的判断变得可解释。过渡到下一部分,我们需要把这套理念落到系统实操与数据素养上。

表格1 传统面试官 vs 数字化面试官:角色与责任对比

| 维度 | 传统面试官(系统前) | 数字化面试官(系统后) | 组织影响 |

|---|---|---|---|

| 决策依据 | 直觉、印象、经验类比 | 证据记录+结构化评分+数据复盘 | 可解释性提升/争议降低 |

| 工作方式 | 单兵作战,信息分散 | 人机协同,多方同屏共享信息 | 协作效率更高 |

| 评价表达 | “好/一般/不合适”等形容词 | 行为证据+岗位维度匹配结论 | 数据可积累、可训练 |

| 过程管理 | 线下沟通、口头同步 | ATS节点推进、自动提醒、留痕 | 招聘周期更可控 |

| 风险视角 | 主要靠经验规避风险 | 合规字段控制+权限管理+审计 | 合规风险下降 |

二、系统操作与AI协同能力(招聘系统上线后,面试官培训内容应该包含哪些模块?)

系统能力的训练目标应当是“在不额外消耗注意力的情况下完成闭环动作”,让面试官把认知资源留给提问、倾听与判断;同时建立AI协同的基本数据素养,避免把AI当权威或当摆设。

1. ATS全流程闭环实操培训

只教“怎么进入系统”远远不够,面试官需要把自己的面试动作与系统节点对齐,否则流程会在关键环节掉链。培训建议按“端到端闭环”设计演练:

(1)职位与候选人信息读取

面试官至少要学会三件事:

- 看懂岗位画像:关键职责、必须项/加分项、团队协作方式、绩效产出指标;

- 快速定位候选人亮点与风险点:跳槽频率、项目跨度、能力断档、空窗解释;

- 识别信息缺口:哪些关键事实在简历里缺失,必须通过追问补齐(例如贡献度、数据口径、失败原因)。

(2)面试邀约与日程协同

系统上线后常见的体验问题不是“约不到人”,而是“信息不一致”:会议号变更、时区/地点错误、面试官临时改期无同步。培训要覆盖:

- 多渠道邀约(邮件/短信/微信或企业IM)的标准模板使用;

- 候选人自助改期与面试官确认机制;

- 线上面试链接、保密提醒、材料准备清单的自动发送。

(3)面试记录与评价提交

这里最容易出现“录入敷衍”。培训要用具体规则约束:

- 评分维度必须与岗位画像一一对应,避免“通用打分”;

- 评语按“证据—判断—建议”写,禁止只写形容词;

- 结论(推荐/保留/不推荐)要绑定关键证据点,便于后续复盘与复用。

(4)offer前后的系统协作

面试官往往认为offer与自己无关,但现实中“抢人”阶段需要业务背书:

- 终面意见与薪酬建议的输入口径;

- 背调关注点(岗位相关)与红线提示;

- 入职前沟通要点同步(避免候选人听到多版本承诺)。

不适用场景提示:如果企业招聘量极小、流程极简(比如小团队一年招几个人),可以适度简化系统节点,但仍建议保留“结构化评价+关键证据记录”,否则很难形成组织级复盘。

2. AI辅助筛选与评估的深度应用

AI能力培训不应停留在“怎么看报告”,而要让面试官理解:AI输出来自哪些输入、哪些权重、哪些偏差来源。我们建议把培训分成两块:简历侧与面试侧。

(1)AI简历打分:读懂权重与偏差

常见模型逻辑包括关键词匹配、技能图谱、行业/岗位相似度、任职时长与经历连续性等。培训重点是让面试官学会三类复核:

- 真实性复核:项目描述与岗位要求高度贴合时,反而要追问“你在其中承担什么角色、怎么拿到数据、谁能证明”。

- 相关性复核:候选人可能具备“可迁移能力”但简历不含关键词(例如从运营转产品、从制造转供应链计划),AI会低估;面试官要用追问验证迁移路径。

- 稀缺性复核:低频但关键能力(例如关键客户经营、复杂组织协同)可能不在高频词里,AI排序会忽略,面试官需要主动捞人。

(2)AI视频面试分析:用“核验”替代“采信”

一些系统会提供语速、停顿、情绪稳定性、关键词覆盖度等指标。培训必须强调两点:

- 指标是线索,不是结论:例如“停顿多”可能来自网络延迟、语言习惯或思考严谨;需要与内容质量一起判断。

- 解释权在面试官:当AI提示“表达不够清晰”,面试官要能追问结构化表达(先结论后论据)并记录改观情况,而不是直接扣分。

副作用提示:过度依赖AI提示,容易把面试变成“对着指标追分”,让候选人体验下降,也会抑制面试官的自主判断;培训中应设置“无AI提示的一轮面试演练”,检验面试官基本功是否扎实。

3. 招聘BI看板的数据解读能力

系统上线后,数据不再只是招聘团队的“报表任务”,而应该成为面试官改进质量的反馈回路。培训建议聚焦三类指标,并要求面试官能把指标转化为动作。

(1)效率类:招聘周期与环节耗时

- 如果“简历到初面”耗时过长:面试官需要承诺固定时段处理候选人,并使用系统提醒与代理机制。

- 如果“终面到offer”拖延:需要明确决策会议节奏,减少反复补面。

(2)质量类:面试通过率、offer接受率、试用期通过率

- 某面试官通过率异常高:可能标准过松,或岗位画像不清;

- 某面试官通过率异常低:可能问题偏离岗位、过度挑剔,或沟通方式导致候选人表现受限;

- offer接受率低:不一定是薪酬问题,也可能是面试过程没有把真实工作场景说清。

(3)渠道类:投递转化率与渠道质量

面试官并非渠道负责人,但对“画像与现实差距”最敏感。培训中应要求面试官在系统里标注“候选人来源与画像偏差”,帮助招聘团队调整JD与投放策略。

边界条件:当企业尚未建立入职后绩效与招聘数据的打通机制时,“质量指标”的解释会受限,培训应先从面试通过率、offer接受率等前置指标入手,逐步推进闭环。

三、结构化面试技术与胜任力评估(招聘系统上线后,面试官培训内容应该包含哪些模块?)

当系统把流程标准化之后,真正拉开差距的是面试官的“结构化判断能力”:能否用一致的框架识别能力与潜力,并把证据写进系统,形成可复用、可校准的数据。

1. 基于胜任力模型的岗位画像构建

很多面试失败并非面试技巧问题,而是“考察目标不清”:同一个岗位,不同面试官理解的关键能力不同,导致问法与评分散乱。培训应把岗位画像的构建作为必修课,并与系统字段对齐。

我们建议采用“六维评价”的思路(维度名称可按企业模型调整):

- 经历:做过什么规模的事,处在什么业务阶段;

- 知识技能:硬技能、工具、行业规则;

- 能力:通用能力(结构化思考、推动协同、问题解决);

- 潜力:学习敏捷、抽象迁移、成长曲线;

- 个性/风格:决策风格、合作偏好、压力反应;

- 动力适配:求职动机、价值取向、对激励方式的偏好。

培训要解决两个机制问题:

- 把“加分项”从口头偏好变成可描述的行为证据:例如“owner意识”对应什么行为(主动界定问题边界、推动资源、对结果负责)。

- 把“不可妥协项”写成可验证判据:例如“必须能独立搭建数据指标体系”,判据是“能讲清指标口径、采集路径、如何用指标驱动动作”。

反例提示:如果岗位本身处于探索期(职责频繁变化),画像不宜写得过细,否则会把“适应性强的人”挡在门外;此时应提高对学习与适应维度的权重,并在系统中明确“探索期岗位”的特殊评分规则。

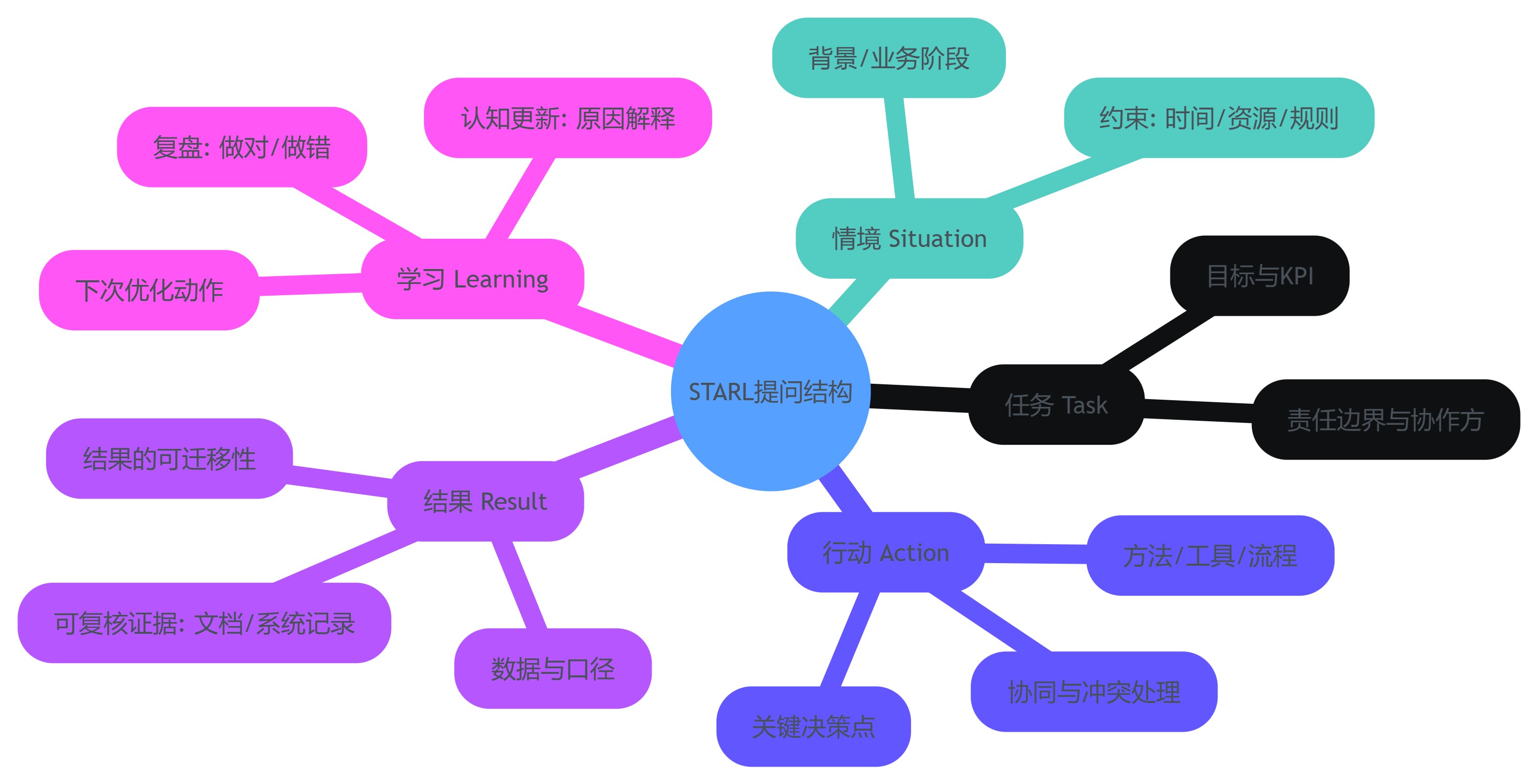

2. 升级版结构化面试技术(STARL法则)

传统STAR(情境-任务-行动-结果)解决了“讲故事散、无法验证”的问题,但在快速变化的岗位上,企业更关心候选人是否能从经验中迭代,因此加入L(Learning)更贴近现实。

培训应按“问题设计—追问技巧—记录方式”三步走:

(1)问题设计:一题一维度

避免“一个问题想考三件事”。例如考察项目管理:

- Situation:项目背景与约束是什么?

- Task:你的目标与责任边界是什么?

- Action:你做了哪些关键动作,如何协调资源?

- Result:结果数据是什么,是否可复核?

- Learning:如果重来一次,你会改哪里?依据是什么?

(2)追问技巧:从结果倒推证据

候选人讲“结果很好”,面试官要追问:

- 数据口径是什么?谁定义的?你贡献的部分如何区分?

- 失败/偏差出现时,你做了什么调整?

- 你当时做决策的备选方案有哪些?为何选这个?

(3)记录方式:把证据写进系统

培训要给出“证据句式”,例如:

- 证据:候选人描述在X项目中负责Y模块,使用Z方法,产出数据A(口径B)。

- 判断:体现了“跨部门推动/结构化拆解/风险控制”中的哪一项。

- 风险:对某关键点叙述模糊/数据不可复核/角色贡献不清。

这里的边界是:结构化不等于机械化。对于创意类、研究类岗位,面试官可以用“作品/研究过程复盘”替代严格STARL,但仍要保留“可验证证据+学习迭代”的记录原则。

图表1 STARL面试提问逻辑结构图

3. 软技能与潜力的数字化评估技巧

系统上线后,面试官容易只盯“硬技能是否匹配”,但很多岗位的失败来自软技能:沟通、协作、抗压、推动力。软技能的难点是“主观”,解决办法是把它变成“情境题+行为证据”。

培训建议用两类题型,并配合系统实时记录与评分:

(1)情景模拟(Case/情境题)

例如考察跨部门协作:

- 情境:资源不足、对方部门优先级不同、时间窗口固定。

- 任务:在两周内完成交付。

- 观察点:是否能澄清目标、分解任务、识别利益相关方、提出交换条件、建立里程碑。

系统记录要求:写明候选人提出的具体动作,而不是“沟通能力强”。

(2)价值观与冲突处理题

例如考察诚信与底线:

- 情境:目标压力大,上级暗示“数据可以优化呈现”。

- 追问:你会怎么做?如何和上级沟通?如果被否决怎么办?

观察点:是否能在合规与业务之间提出可行替代方案,而不是停留在口号。

潜力评估的一个常见误区是把“表达流畅”当“思考深”。培训中应加入“反证追问”:当候选人给出结论时,要求其提出反例或限制条件,检验其批判性思维与自我校准能力。

副作用提示:情景题如果过度追求“标准答案”,会筛掉多样化的人才。培训应强调:评分依据是“逻辑与行动可行性”,而非“是否与面试官经验一致”。

4. 面试评价表的标准化填写规范

评价表是系统里最容易被轻视的模块,却直接决定数据能否沉淀。培训应给出清晰的“写作与评分规则”,并用例子校准。

(1)评分规则:先证据后分数

要求面试官在每个维度至少写1条证据,再给分数;没有证据的高分一律视为无效评分(可由系统校验提醒)。

(2)用事实替代形容词

- 不推荐写法:沟通好/思路清晰/抗压强。

- 推荐写法:在冲突场景中先复述对方诉求,再提出两种备选方案并给出取舍依据;面对追问能说明数据口径与来源。

(3)明确“推荐/保留”的条件

例如:

- 推荐:满足必须项A、B;加分项C有证据;风险项可通过入职后辅导解决。

- 保留:必须项A证据不足,需要二面补证据;或与另一候选人对比后再定。

边界条件:如果企业面试官数量多、地域分散,建议把“评价表填写”做成带示例的短视频与评分校准题库,减少一次性培训后的遗忘成本。下一部分将把“体验与合规”作为同等重要的模块纳入培训。

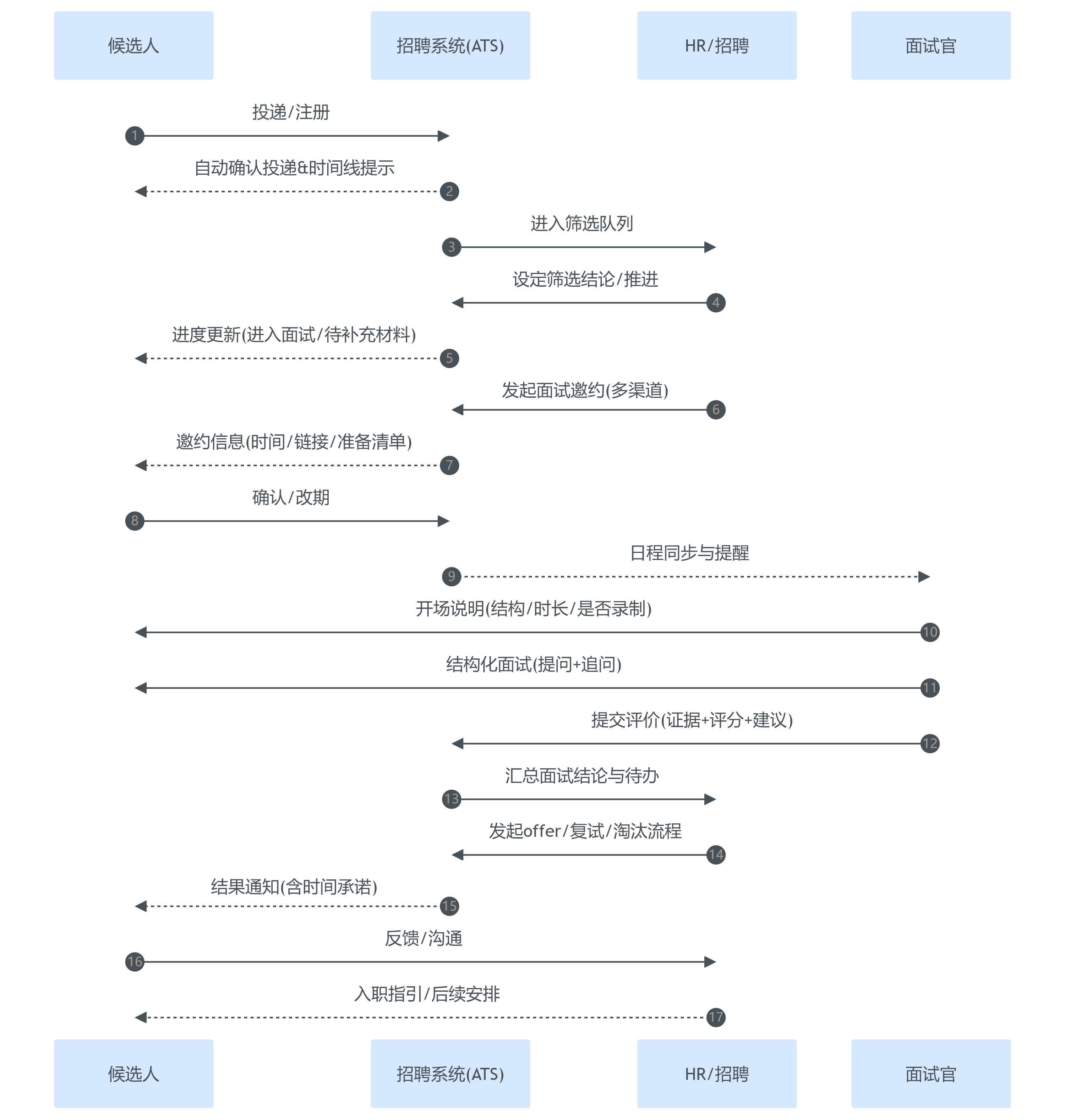

四、候选人体验(CX)管理与合规风控

当招聘系统把流程节点公开化后,候选人体验会被放大:一次延迟反馈、一次不专业的视频面试环境、一次不当提问,都可能转化为雇主品牌损耗;同时数字化记录也意味着合规风险更可追溯,培训必须把“体验与风控”做成可执行清单。

1. 全流程候选人体验(CX)优化

候选人体验不是“礼貌用语”,而是一个可以被流程设计与系统触点管理的结果。培训重点应落在三个高频断点:

(1)进度透明与反馈时效

- 系统能自动通知的节点要用起来:投递已收到、进入筛选、面试安排、结果反馈;

- 对需要人工判断的节点设定SLA:例如面试后24-48小时内给出结果或明确下一步时间。

这里的机制是降低候选人不确定性,从而减少爽约与流失。

(2)视频面试的“专业化标准”

视频面试不是线下面试的复制,它对环境与节奏更敏感。培训应规定:

- 设备与网络检查(提前10分钟进入会议);

- 光线、背景、收音与镜头角度;

- 开场说明(时长、结构、是否录制、如何提问);

- 过程中对延迟的容错(允许候选人复述问题、适度停顿)。

不适用场景提示:对保密级别高的岗位或涉密项目,视频面试可能需要改为线下或使用企业内网工具,并提前完成合规告知。

(3)把真实工作场景说清楚

面试官往往只评估不介绍,导致候选人入职后落差大。培训应要求面试官至少覆盖:团队协作方式、绩效评价逻辑、近期业务挑战与工作节奏。真实信息会降低短期接受率,但通常提升长期留存,这是典型的“用短期指标换长期质量”的选择。

2. 数字化招聘中的合规与隐私保护

系统上线后,很多“以前口头说说”的内容会进入系统字段与备注区,一旦出现敏感信息,风险更集中。培训应以“红线清单+替代表达”方式落地。

(1)个人信息保护的基本要求(面试官视角)

- 只收集与岗位相关的信息:不因“好奇”而追加无关材料;

- 系统备注禁止记录敏感或歧视性内容(婚育、宗教、民族、健康状况等);

- 若使用AI面试/录音录像,必须按公司流程完成告知与授权(具体以企业合规制度为准)。

(2)面试提问的合规边界

培训要把“不能问什么”讲透,并给替代问法:

- 不建议:你结婚了吗?打算什么时候要孩子?

- 替代:这个岗位需要在旺季加班/出差,你是否能接受?(并说明频率与边界)

- 不建议:你之前工资多少?

- 替代:你的薪资期望区间与构成是什么?哪些条件会影响你选择?(同时遵循公司薪酬政策)

副作用提示:过度“避雷”可能让面试官变得僵硬,影响对话质量。培训中应通过情景演练,让面试官在合规前提下依然能把关键约束条件问清楚。

3. 雇主品牌在面试环节的渗透

雇主品牌不是市场部单独完成的,面试官在系统与沟通中的行为,直接决定候选人对企业“专业度”的判断。培训可从三个触点入手:

- 流程专业:邀约信息完整、改期机制清晰、面试官准时;

- 表达专业:问题与岗位相关、追问有逻辑、反馈有边界;

- 承诺一致:面试官对岗位信息、发展路径、薪酬结构的表达与HR一致,避免多版本。

当系统能沉淀候选人反馈(满意度/体验问卷)时,建议把其纳入面试官画像,用数据推动行为改变,但需注意:样本量小或岗位差异大时,不能简单用分数排名,应结合文本反馈与具体场景复盘。

表格2 视频面试前/中/后:面试官自查清单(CX与合规)

| 阶段 | 自查项 | 合格标准(可操作) |

|---|---|---|

| 面试前 | 设备与网络 | 提前10分钟入会;摄像头、麦克风正常;备用网络准备 |

| 面试前 | 场地与背景 | 背景干净、光线正面;避免公共场所;不展示敏感信息 |

| 面试前 | 告知与授权 | 如涉及录音/录像/AI辅助,按公司模板完成告知与确认 |

| 面试中 | 开场说明 | 说明时长、结构、提问方式、候选人可提问时间 |

| 面试中 | 提问合规 | 不问婚育/宗教/健康等;问题与岗位要求可解释关联 |

| 面试中 | 记录规范 | 记录事实证据而非主观标签;关键结论可追溯 |

| 面试后 | 反馈时效 | 在SLA内提交评价;必要时给出下一步时间点 |

| 面试后 | 信息保密 | 不外传面试内容与候选人信息;不在非系统渠道留存简历 |

图表2 候选人体验(CX)全旅程时序图:关键触点与MOT

结语

回到开篇问题:招聘系统上线后,面试官培训内容应该包含哪些模块?答案不是“系统操作课+面试技巧课”两张PPT就能覆盖,而是要把面试官从角色认知、工具协同、结构化评估到体验与合规,连成一条闭环能力链。系统让流程可控,培训让判断可复制;两者缺一,都会把招聘变成“看起来很数字化”的低质量运转。

可直接执行的建议如下(适用于多数已上线ATS的企业):

- 把培训拆成四段并设门槛:理念与边界(必修)→系统闭环实操(通关)→结构化面试与评分校准(认证)→CX与合规情景演练(复训),建议建立“认证后上岗”的机制。

- 用“证据质量”而非“打分速度”考核面试官:抽检评价表,要求每个维度有可复核证据;对高频形容词与无证据高分做纠偏。

- 将AI训练成“提示系统”:培训面试官统一执行“AI提示—人工复核—结构化反馈”,并明确哪些环节可用AI分流、哪些必须人主导。

- 建立月度校准会:用同一候选人样本做评分对齐,结合BI看板看通过率/接受率/试用期表现,持续修正画像与题库。

- 把体验SLA写进面试官职责:明确反馈时效、视频面试规范与信息一致性要求,用候选人反馈做改进依据但避免简单排名。